Φανταστείτε έναν υπολογιστή που θα μπορούσε να ολοκληρώσει τις προτάσεις σας χρησιμοποιώντας μια καλύτερη φράση ή θα μπορούσε να χρησιμοποιήσει ένα κομμάτι μελωδίας για να συνθέσει μουσική που θα ακούγεται σαν να την γράψατε εσείς (χωρίς να το έχετε κάνει εσείς), ή θα μπορούσε να λύσει ένα πρόβλημα δημιουργώντας εκατοντάδες γραμμές υπολογιστικού κώδικα, αφήνοντάς σας να επικεντρωθείτε σε κάτι ακόμη πιο δύσκολο.

Κατά μία έννοια, αυτός ο υπολογιστής είναι απλώς ο απόγονος των αργαλειών και των ατμομηχανών που επιτάχυναν τη Βιομηχανική Επανάσταση. Ανήκει όμως και σε μια νέα κατηγορία μηχανών, επειδή αντιλαμβάνεται τα σύμβολα της γλώσσας, της μουσικής και του προγραμματισμού και τα χρησιμοποιεί με τρόπους που φαίνονται δημιουργικοί. Σαν τον άνθρωπο.

Τα «μοντέλα θεμελίωσης» που μπορούν να κάνουν αυτά τα πράγματα αποτελούν μια σημαντική ανακάλυψη στην τεχνητή νοημοσύνη, ή ΑΙ για συντομία. Υπόσχονται κι αυτά μια επανάσταση, αλλά αυτή θα επηρεάσει την υψηλού επιπέδου εγκεφαλική εργασία που η Βιομηχανική Επανάσταση δεν άγγιξε ποτέ.

Δεν υπάρχουν εγγυήσεις για το τι μέλλει γενέσθαι – άλλωστε, η τεχνητή νοημοσύνη έχει σκοντάψει στο παρελθόν. Όμως, είναι καιρός να εξετάσουμε τις υποσχέσεις και τους κινδύνους του επόμενου μεγάλου πράγματος στη μηχανική νοημοσύνη.

Τα μοντέλα θεμελίωσης είναι η πιο πρόσφατη εκδοχή της «βαθιάς μάθησης» (DL), μιας τεχνικής που έγινε γνωστή πριν από δέκα χρόνια και σήμερα κυριαρχεί στον τομέα της τεχνητής νοημοσύνης. Τα συστήματα βαθιάς μάθησης, τα οποία βασίζονται στη δικτυακή δομή των νευρώνων του ανθρώπινου εγκεφάλου, «εκπαιδεύονται» χρησιμοποιώντας εκατομμύρια ή δισεκατομμύρια παραδείγματα κειμένων, εικόνων ή ηχητικών κλιπ.

Τα τελευταία χρόνια, το αυξανόμενο κόστος, σε χρόνο και χρήμα, της εκπαίδευσης όλο και μεγαλύτερων συστημάτων βαθιάς μάθησης είχε προκαλέσει ανησυχίες ότι η τεχνική έφτανε στα όριά της. Ορισμένοι έκαναν λόγο για τον «χειμώνα της τεχνητής νοημοσύνης».

Όμως, τα μοντέλα θεμελίωσης δείχνουν ότι η κατασκευή ολοένα μεγαλύτερης και πιο πολύπλοκης βαθιάς μάθησης συνεχίζει πράγματι να ξεκλειδώνει όλο και εντυπωσιακότερες νέες δυνατότητες. Κανείς δεν ξέρει πού βρίσκεται το όριο.

Τα μοντέλα που προκύπτουν αποτελούν μια νέα μορφή δημιουργικής, μη ανθρώπινης νοημοσύνης. Τα συστήματα είναι αρκετά εξελιγμένα ώστε να κατανοούν τη γλώσσα αλλά και να παραβιάζουν τους κανόνες με συνοχή. Ένας σκύλος δεν μπορεί να γελάσει με ένα ανέκδοτο στο New Yorker, αλλά μια τεχνητή νοημοσύνη μπορεί να εξηγήσει γιατί είναι αστείο – ένα κατόρθωμα που, ειλικρινά, μερικές φορές υπερβαίνει τους αναγνώστες του New Yorker.

Όταν ζητήσαμε από ένα από αυτά τα μοντέλα να δημιουργήσει ένα κολάζ χρησιμοποιώντας τον τίτλο του ηγέτη και τίποτε άλλο, κατέληξε στο εξώφυλλο της αμερικανικής και ασιατικής έκδοσης.

Τα μοντέλα θεμελίωσης έχουν ορισμένες εκπληκτικές και χρήσιμες ιδιότητες. Η πιο παράξενη από αυτές είναι η «αναδυόμενη» συμπεριφορά τους – δηλαδή, δεξιότητες (όπως η ικανότητα να πιάνεις ένα αστείο ή να ταιριάζεις μια κατάσταση με μια παροιμία) που προκύπτουν από το μέγεθος και το βάθος των μοντέλων, αντί να είναι αποτέλεσμα σκόπιμου σχεδιασμού.

Ακριβώς όπως μια γρήγορη διαδοχή ακίνητων φωτογραφιών δίνει την αίσθηση της κίνησης, έτσι και τρισεκατομμύρια δυαδικές υπολογιστικές αποφάσεις συγχωνεύονται σε μια προσομοίωση της ρευστής ανθρώπινης κατανόησης και δημιουργικότητας που, ό,τι κι αν λένε οι φιλόσοφοι, μοιάζει πολύ με την πραγματικότητα. Ακόμη και οι δημιουργοί αυτών των συστημάτων εκπλήσσονται από τη δύναμή τους.

Αυτή η νοημοσύνη είναι ευρεία και προσαρμόσιμη. Είναι αλήθεια ότι τα μοντέλα θεμελίωσης είναι ικανά να συμπεριφέρονται σαν ηλίθια, αλλά το ίδιο και οι άνθρωποι. Αν ρωτήσετε κάποιον ποιος κέρδισε το βραβείο Νόμπελ Φυσικής το 1625, μπορεί να προτείνει τον Γαλιλαίο, τον Μπέικον ή τον Κέπλερ, χωρίς να καταλαβαίνει ότι το πρώτο βραβείο απονεμήθηκε το 1901.

Ωστόσο, είναι επίσης προσαρμόσιμα με τρόπους που τα προηγούμενα συστήματα τεχνητής νοημοσύνης δεν ήταν, ίσως επειδή σε κάποιο επίπεδο υπάρχει ομοιότητα μεταξύ των κανόνων χειρισμού των συμβόλων σε κλάδους τόσο διαφορετικούς όσο η ζωγραφική, η δημιουργική γραφή και ο προγραμματισμός ηλεκτρονικών υπολογιστών.

Αυτό το εύρος σημαίνει ότι τα μοντέλα θεμελίωσης θα μπορούσαν να χρησιμοποιηθούν σε πολλές εφαρμογές, από τη βοήθεια στην εύρεση νέων φαρμάκων με τη χρήση προβλέψεων για τον τρόπο με τον οποίο οι πρωτεΐνες αναδιπλώνονται σε τρεις διαστάσεις, μέχρι την επιλογή μιας ενδιαφέρουσας γραφικής παράστασης από σύνολα δεδομένων και την διαχείρηση ανοικτών ερωτήσεων με τη διερεύνηση τεράστιων βάσεων δεδομένων για τη διατύπωση απαντήσεων που ανοίγουν νέους τομείς έρευνας.

Αυτό είναι συναρπαστικό και υπόσχεται μεγάλα οφέλη, τα περισσότερα από τα οποία πρέπει ακόμη να φανταστούμε. Αλλά προκαλεί και ανησυχίες. Αναπόφευκτα, ο κόσμος φοβάται ότι το γεγονός ότι τα Συστήματα Τεχνητής Νοημοσύνης είναι αρκετά δημιουργικά ώστε να εκπλήσσουν και τους δημιουργούς τους μπορεί να μετατραπεί σε μάστιγα.

Στην πραγματικότητα, τα μοντέλα θεμελίωσης απέχουν έτη φωτός από τα ευαίσθητα ρομπότ-δολοφόνους που αγαπά το Χόλιγουντ. Οι εξολοθρευτές τείνουν να είναι εστιασμένοι, εμμονικοί και τυφλοί απέναντι στις ευρύτερες συνέπειες των πράξεών τους.

Η Θεμελιώδης Τεχνητή Νοημοσύνη, αντίθετα, είναι ασαφής. Ομοίως, οι άνθρωποι ανησυχούν για τις τεράστιες ποσότητες ενέργειας που καταναλώνουν αυτά τα μοντέλα και τις εκπομπές που παράγουν.

Ωστόσο, τα Συστήματα Τεχνητής Νοημοσύνης γίνονται όλο και πιο αποδοτικά και οι γνώσεις τους μπορεί κάλλιστα να είναι απαραίτητες για την ανάπτυξη της τεχνολογίας που θα επιταχύνει τη στροφή προς τις ανανεώσιμες πηγές ενέργειας.

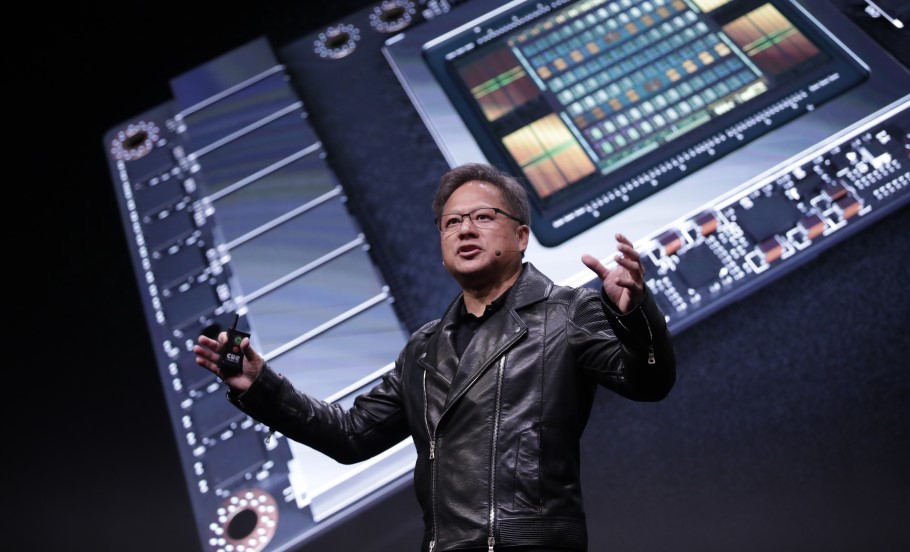

Μια πιο διεισδυτική ανησυχία αφορά το ποιος ελέγχει τα μοντέλα θεμελίωσης. Η εκπαίδευση ενός πραγματικά μεγάλου συστήματος, όπως το Google PaLM, κοστίζει περισσότερα από 10 εκατομμύρια δολάρια η προσπάθεια και απαιτεί πρόσβαση σε τεράστιες ποσότητες δεδομένων – όσο περισσότερη υπολογιστική ισχύς και όσο περισσότερα δεδομένα τόσο το καλύτερο.

Αυτό εγείρει ανησυχίες ότι πρόκειται για μια τεχνολογίας που συγκεντρώνεται στα χέρια ενός μικρού αριθμού τεχνολογικών εταιρειών ή κυβερνήσεων.

Αν είναι έτσι, τα δεδομένα εκπαίδευσης θα μπορούσαν να δημιουργήσουν περαιτέρω προκαταλήψεις στον κόσμο – και μάλιστα με έναν ιδιαίτερα ασφυκτικό και δυσάρεστο τρόπο. Θα εμπιστευόσασταν ένα δεκάχρονο παιδί του οποίου ολόκληρη η αίσθηση της πραγματικότητας έχει διαμορφωθεί από την περιήγηση στο διαδίκτυο;

Μήπως τα εκπαιδευμένα στην Κίνα και την Αμερική Συστήματα Τεχνητής Νοημοσύνης θα μπορούσαν να στρατολογηθούν σε έναν ιδεολογικό αγώνα για την κάμψη της ελεύθερης βούλησης; Τι θα συμβεί στους πολιτισμούς που εκπροσωπούνται ελάχιστα στο διαδίκτυο;

Και έπειτα τίθεται και το ζήτημα της πρόσβασης. Προς το παρόν, τα μεγαλύτερα μοντέλα είναι περιορισμένα, ώστε να αποτραπεί η χρήση τους για κακόβουλους σκοπούς, όπως η παραγωγή ψεύτικων ειδήσεων. Η Openai, μια νεοσύστατη εταιρεία, σχεδίασε το μοντέλο της, που ονομάζεται DALL·E 2, σε μια προσπάθεια να σταματήσει την παραγωγή βίαιων ή πορνογραφικών εικόνων.

Οι επιχειρήσεις έχουν δίκιο να φοβούνται την κατάχρηση, αλλά όσο πιο ισχυρά γίνονται αυτά τα μοντέλα, τόσο περισσότερο ο περιορισμός της πρόσβασης σε αυτά δημιουργεί μια νέα ελίτ. Η αυτορύθμιση είναι απίθανο να επιλύσει το δίλημμα.

Η επανάσταση προ των πυλών

Εδώ και χρόνια λέγεται ότι η αυτοματοποίηση με τη βοήθεια της τεχνητής νοημοσύνης αποτελεί απειλή για τους ανθρώπους που εργάζονται σε επαναλαμβανόμενες, εργασίες ρουτίνας και ότι οι καλλιτέχνες, οι συγγραφείς και οι προγραμματιστές είναι πιο ασφαλείς. Τα μοντέλα θεμελίωσης αμφισβητούν αυτή τη παραδοχή.

Αλλά δείχνουν επίσης πώς η τεχνητή νοημοσύνη μπορεί να χρησιμοποιηθεί ως βοηθός λογισμικού για την ενίσχυση της παραγωγικότητας. Αυτή η μηχανική νοημοσύνη δεν μοιάζει με το ανθρώπινο είδος, αλλά προσφέρει κάτι εντελώς διαφορετικό. Με σωστό χειρισμό, είναι πιθανότερο να συμπληρώσει την ανθρωπότητα παρά να τη σφετεριστεί.

© 2022 The Economist Newspaper Limited. All rights reserved.

Άρθρο από τον Economist το οποίο μεταφράστηκε και δημοσιεύθηκε με επίσημη άδεια από την www.powergame.gr Το πρωτότυπο άρθρο, στα αγγλικά βρίσκεται στο www.economist.com